尽管目前VLM在多模态任务上表现突出,但训练过度依赖人工标注的数据与精心设计的强化学习奖励。这种依赖带来数据稀缺问题:多模态标注成本高昂,限制了训练数据的规模与多样性。同时存在知识天花板:模型能力受人类监督边界限制,难以突破人类已有知识和策略。曾经AlphaGo所使用的自博弈技术通过模型与自身副本竞争交互并自动获取反馈,把计算转变为数据的同时消除了对人工监督的依赖,这使得它能够持续推动模型进步并突破人类能力上限。但是受制于VLM的多模态特性,目前鲜有对自博弈在VLM上应用的系统性研究。为此研究团队设计了一套适应VLM特性的自博弈框架Vision-Zero,此框架有如下特点:

(1)策略自博弈框架:Vision-Zero在以社交推理类游戏为模板的环境中训练VLM,使得agent在自博弈过程中自动生成高复杂度推理数据,而无需人工标注。

(2)任意形式的图片都可作为输入:和以往有限制条件的游戏化训练框架不同的是,Vision-Zero可在任意形式的图片上启动游戏,这使得模型可以在很多不同的领域里获得相应的能力提升,并有很好的泛化性能。

(3)持续的性能提升:研究团队提出了自博弈和可验证奖励的强化学习(RLVR)交替优化的自博弈策略优化算法(Iterative-SPO),这一算法解决了传统自博弈算法中常见的性能瓶颈问题。

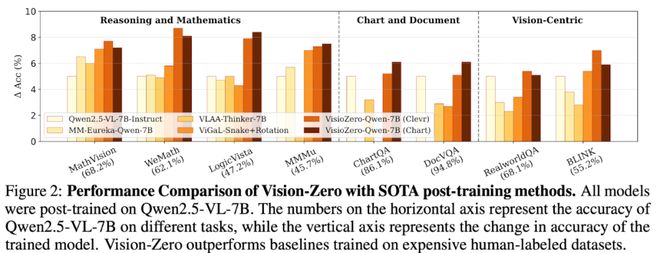

尽管没有用任何标注数据做训练,Vision-Zero在多个领域如推理,图表问答和Vision-Centric理解任务上超越了其他有标注的SOTA后训练方法。

从棋盘到现实:

AlphaGo自博弈思想的泛化

自博弈作为OpenAI早期的重要技术路线之一,也是人工智能发展历程中多项里程碑事件的关键推动力。典型代表包括2016年AlphaGo战胜李世石,以及2019年OpenAI Five在Dota 2上击败世界冠军OG战队。人们在看到自博弈在某些特定领域大幅超越人类智能的同时,往往也会思考我们是否有可能把这种思想应用到更多的开放场景中。然而让AlphaGo从棋盘走入现实需要解决以下几个难题:

(1)Agent为赢得博弈所习得的技能,应当与目标任务所需的技能高度一致。

(2)博弈环境应当足够多样且复杂,以便广泛的目标任务都能够满足条件(1)。

(3)技能增长应当具有可扩展性:随着自博弈的进行,环境应当不断提高难度,使得越来越强的智能体能够涌现,而不是让训练收敛到一个固定的上限。

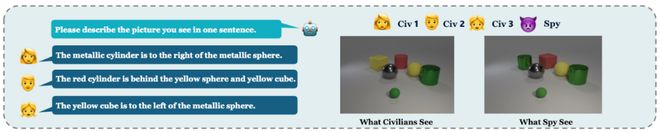

受到社交推理游戏,如“谁是卧底”的启发,研究团队设计了一套完备的自博弈规则以解决上述难题,具体规则如下:

(1)游戏中有n名平民和1名卧底。玩家首先被告知自己的角色。

(2)每名玩家会得到一张图片,卧底的图片与平民略有不同(如缺失、添加或修改了某个物体)。

(3)线索阶段:每位玩家观察自己的图片,并给出一个口头线索,描述图片内容(可以是物体描述、推断信息等)。

(4)决策阶段:多轮线索给出后,进入决策阶段。玩家根据线索结合自己的图片,投票找出卧底。

此游戏具有高度策略性与挑战性,卧底需要根据他人线索推断并伪装自己,避免暴露。平民需要提供足够准确但不泄密的线索,同时分析他人线索寻找可疑点。如此一来,Agent在游戏过程中便可生成足够长且复杂的推理链条,并且随着对手能力的提升,其所面临的挑战也会越来越大,并被激发出更强的视觉理解与推理能力。